OpenAI ha anunciado que incluirá publicidad en ChatGPT. Esta decisión, aunque pasó algo desapercibida en medio del bullicio tecnológico, marca un punto de inflexión para la privacidad digital. Nos invita a pensar en cómo evolucionan nuestras interacciones con la inteligencia artificial.

Desde el punto de vista empresarial, el paso es lógico. Entrenar y mantener estos modelos implica gastos enormes, y la publicidad proporciona ingresos que pueden escalar. Sin embargo, surge una pregunta interesante: ¿qué significa esto para las conversaciones que mantenemos con estas herramientas?

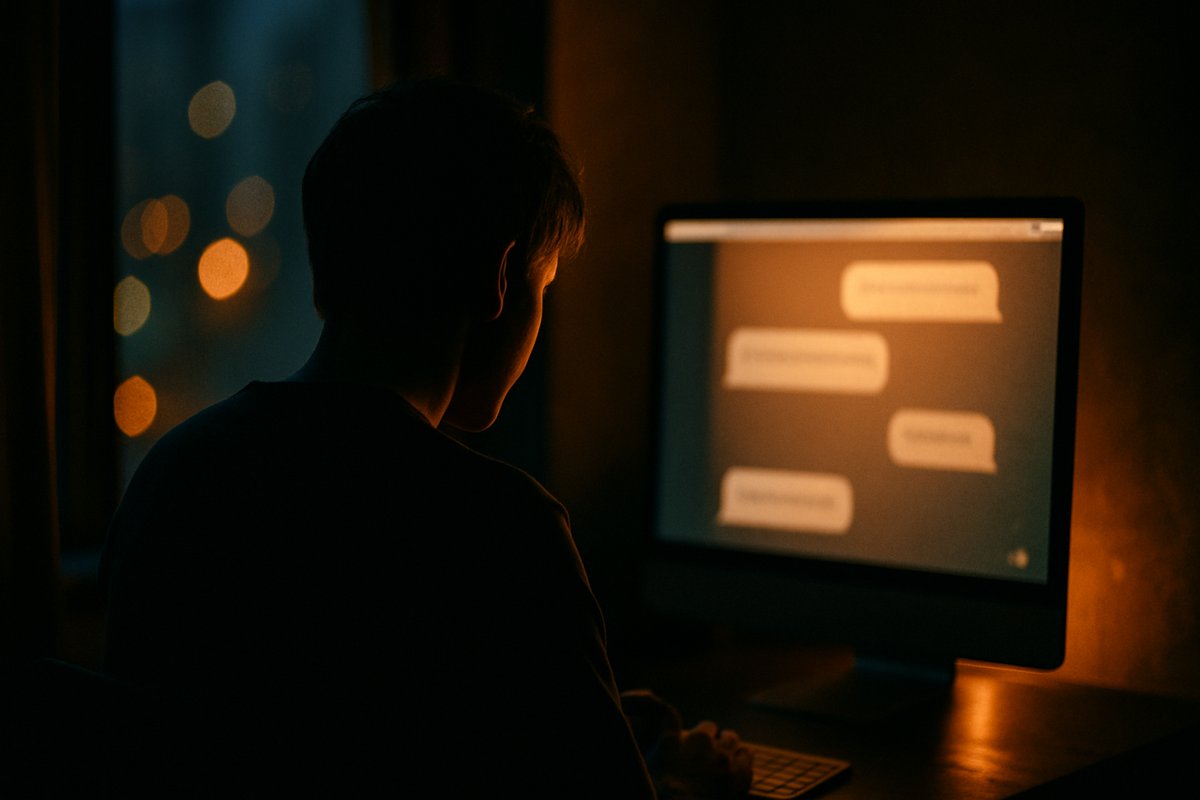

Imagina las preguntas que le haces a ChatGPT. Reflexiones profundas a medianoche, inquietudes sobre la salud, dilemas familiares o dudas laborales que no compartirías fácilmente. Estos datos, una vez analizados, podrían usarse para crear perfiles publicitarios muy precisos. Es curioso cómo algo tan personal se transforma en oportunidad comercial.

Google ya usa nuestra actividad en los navegadores para publicidad, pero hay una diferencia clave. Buscar "síntomas de ansiedad" en Google es consultar un vasto océano de información. Preguntárselo a ChatGPT se siente como una charla confidencial. Esa sensación de cercanía hace que los datos sean aún más valiosos.

Esto me recuerda patrones históricos, como los de la Revolución Industrial. Allí, el trabajo y el tiempo familiar se convirtieron en recursos para el capital, lo que antes era privado se volvió productivo. Las evidencias arqueológicas de esa era, como las herramientas y los registros obreros, muestran cómo se alteraron las vidas cotidianas. En el mundo digital, vemos ecos similares.

La postura de Anthropic es notable aquí. Optan por un modelo de suscripción sin anuncios, sosteniendo que la publicidad distorsiona los objetivos del diseño. Claude prioriza la utilidad genuina, sin la presión de retener atención para vender espacios. En mi experiencia, he visto cómo estos incentivos cambian prioridades en diferentes contextos.

Los modelos de código abierto, como Llama o Mistral, abren otro camino. Al ejecutarlos localmente, tus interacciones quedan en tu dispositivo. No hay rastreo ni segmentación. Es una opción que protege la privacidad desde el origen, y gana terreno rápidamente.

Reconozco estos patrones de otros ámbitos. Cuando las organizaciones dependen de publicidad, a menudo priorizan captar tiempo sobre resolver necesidades reales. El usuario pasa de ser el foco a convertirse en el producto. Pero hay alternativas viables que alinean mejor los intereses.

El modelo publicitario también invita a reflexionar sobre influencias sutiles. Si ChatGPT detecta que estás lidiando con una separación, ¿qué sugerencias aparecerán? ¿Opciones de apoyo emocional, quizás? Vale la pena considerar cómo evitar que la vulnerabilidad se explote, aunque las compañías prometan sensibilidad.

Lo alentador es que las opciones abundan. Cooperativas digitales, suscripciones puras y software abierto demuestran que se puede innovar sin sacrificar la privacidad. No repetiremos los tropiezos de las redes sociales si elegimos conscientemente.

Algunos países exploran infraestructuras de IA pública, viéndola como un servicio esencial, similar a bibliotecas o espacios comunitarios. ¿Qué surgiría si la IA conversacional fuera un bien compartido? Es un experimento que despierta curiosidad.

Esta movida de OpenAI nos lleva a preguntas esenciales sobre el futuro de nuestras charlas con máquinas. ¿Permitiremos que datos íntimos se usen para ventas? ¿O buscaremos modelos que honren nuestra privacidad y autonomía? Todavía no tengo claro el desenlace, pero sigo explorando estas ideas.

Aún hay tiempo para trazar un rumbo distinto. Los modelos abiertos avanzan, las cooperativas crecen y la conciencia sobre datos se fortalece. La comercialización de la intimidad digital es una opción, no un destino fijo.

Las piedras no mienten, pero los historiadores a veces sí.