Dos veredictos en cuarenta y ocho horas. El veinticuatro de marzo, un tribunal en Nuevo México declaró a Meta responsable por no proteger a menores de depredadores sexuales en sus plataformas, con una sanción de trescientos setenta y cinco millones de dólares. Al día siguiente, en Los Ángeles, otro jurado encontró a Meta y YouTube responsables por un diseño adictivo que dañó la salud mental de una joven. Esa coincidencia no es casual. Representa una convergencia en los tribunales, y lo que ambos fallos juntos señalan es algo que la industria tecnológica ha evitado con astucia durante años: responsabilidad directa por la forma en que construye sus plataformas.

Lo que los jurados evaluaron no fue el contenido generado por usuarios. Eso se había intentado antes, y la Sección 230 de la ley de comunicaciones de Estados Unidos bloqueó esas demandas de manera sistemática durante décadas, blindando a las plataformas de cualquier culpa por lo que terceros publican. Esta vez, los abogados variaron el enfoque: cuestionaron la arquitectura misma del producto. El desplazamiento infinito. Los algoritmos de recompensa variable que determinan qué mostrar, en qué momento y a quién, con el fin expreso de prolongar el tiempo en pantalla. El jurado aceptó esa perspectiva. Ese desplazamiento —del contenido a la ingeniería— genera repercusiones legales que aún estamos midiendo.

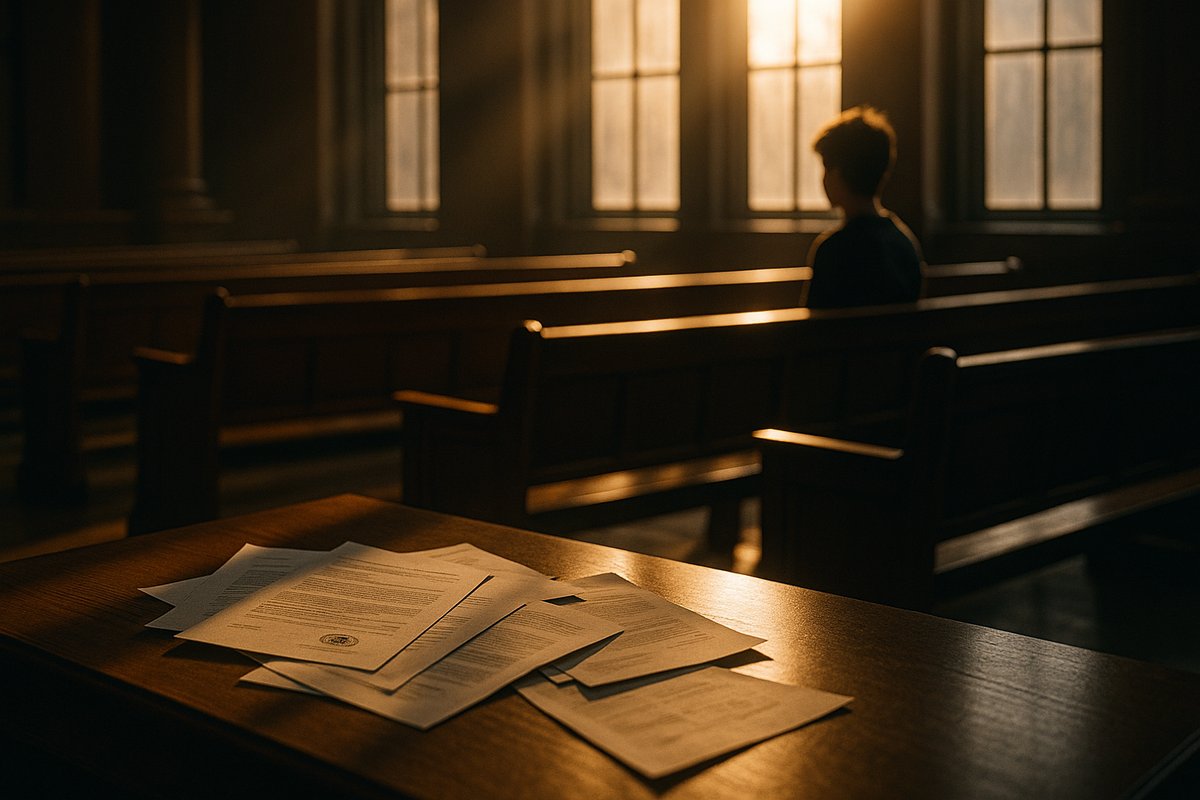

Los documentos internos presentados en el juicio resultan reveladores. No por exponer un fallo o un cálculo erróneo, sino por documentar una elección deliberada. Un ejecutivo de Meta escribió textualmente: "If we wanna win big with teens, we must bring them in as tweens." Otro registro mostraba que niños de once años regresaban a Instagram con cuatro veces más frecuencia que a otras aplicaciones, pese a que la plataforma exige al menos trece años para registrarse. Eso no es un defecto. Es un objetivo de diseño explícito. Investigadores han argumentado durante años que distinguir entre error e intención define la negligencia. Aquí, esa distinción quedó plasmada en los archivos de la empresa.

Cuando un modelo se optimiza para un solo indicador, el resto se convierte en externalidades. Los costos no contabilizados terminan recayendo en otros. En este caso, esos otros fueron adolescentes. Meta no creó plataformas fallidas: creó plataformas que operaron exactamente como sus incentivos lo prescribían. Los archivos también indican que la empresa mantuvo filtros de "belleza" pese a las alertas de dieciocho expertos internos sobre el impacto en la imagen corporal de usuarias jóvenes. El perjuicio no fue fortuito. Fue un costo que otros asumieron.

La comparación con la industria tabacalera va más allá de la retórica. Es estructural. Las tabacaleras conocían los riesgos, los registraron internamente, los negaron en público y los combatieron en tribunales durante décadas. El giro en esa industria no vino de un fallo aislado, sino de una acumulación de jurisprudencia, presiones regulatorias globales y, al final, sanciones que hicieron el modelo de negocio insostenible. Hoy hay al menos dos mil cuatrocientas siete demandas consolidadas en un tribunal federal de California, entre ellas ochocientas de juntas escolares que atribuyen a Meta, TikTok y Snapchat los gastos en orientación psicológica y seguridad para sus estudiantes. Otro juicio federal está previsto para junio de dos mil veintiséis, donde un juez podría imponer modificaciones algorítmicas, como prohibir el desplazamiento infinito para menores. La dinámica se repite. La magnitud crece.

El alcance trasciende Estados Unidos. En Australia, los nuevos códigos de material restringido por edad entraron en vigor en marzo de dos mil veintiséis, y analistas legales ya ven en el veredicto una herramienta para litigios locales. En el Reino Unido, los costos sociales anuales por enfermedad mental superan las noventa y cuatro mil millones de libras; si parte de eso se vincula causalmente a las plataformas, el perjuicio económico eclipsaría todos los casos previos. En Filipinas, el debate sobre una prohibición total para menores gana respaldo judicial concreto, más allá de argumentos políticos. TikTok y Snap, que pactaron antes del juicio, usan mecanismos similares a los declarados adictivos. El acuerdo no anula esa calificación.

Lo que añade tensión ocurrió un día después. El veintiséis de marzo, mientras los veredictos se difundían mundialmente, el Parlamento Europeo aprobó su postura sobre la ley de inteligencia artificial, eximiendo de reglas más rigurosas a los sistemas en sectores como banca, salud e infraestructura. Dos movimientos simultáneos, en direcciones contrarias, ante la misma pregunta: ¿quién responde cuando un diseño algorítmico genera daño? En California, un jurado dijo que alguien debe responder. En Bruselas, el parlamento indicó que los sectores ya regulados no necesitan rendición de cuentas adicional bajo el nuevo marco. Esa brecha no es solo geográfica. Es de fondo. Y no se cierra sola.

Lo que estos fallos no resuelven también merece atención. Seis millones de dólares para Meta y Google equivalen a una fracción mínima frente a presupuestos de capital que superan los cien mil millones anuales cada uno. Una sanción que no altera el balance costo-beneficio interno no modifica el diseño. Queda por ver si las sanciones punitivas venideras, las regulaciones acumuladas y los dos mil cuatrocientos casos pendientes logran lo que los veredictos iniciales no consiguen: reorientar los incentivos. Mientras el tiempo en pantalla siga siendo más rentable que la protección de usuarios, las prioridades no cambian. Hay indicios de que diseños centrados en el bienestar podrían ganar terreno si la presión judicial persiste, pero eso depende de que la presión no ceda.

Las redes sociales no inventaron la captura de atención. Los casinos refinaron la recompensa variable antes del desplazamiento infinito. La publicidad ha optimizado el tiempo de exposición por más de un siglo. Lo novedoso es la escala y la precisión: los algoritmos personalizan el enganche por usuario, en tiempo real, para miles de millones de personas. Y lo afinan para los más vulnerables: jóvenes con cerebros en formación, más sensibles a los estímulos de recompensa. Estas dinámicas tienden a concentrar poder en lugar de distribuirlo, acelerando desigualdades existentes. El juicio no culpa a la tecnología. Señala la elección de quienes optaron por ese diseño sabiendo sus efectos. Esa elección ahora tiene peso legal.

La invencibilidad de las grandes tecnológicas podría estar en declive. O podría inaugurar una era de apelaciones prolongadas. Probablemente ambas. Lo que no tiene vuelta atrás es que un jurado validó que el problema estaba en la lógica del producto desde su origen. No en usuarios abusivos. No en padres descuidados. En la ingeniería intencional de la dependencia. Una vez en el registro judicial, eso no desaparece. Los precedentes legales actúan como piedras: resisten aunque queden olvidados.

Las piedras no mienten, pero los historiadores a veces sí.

Fuentes:

1. LA NACION — Veredicto de Nuevo México contra Meta, 24 de marzo de 2026

2. NPR — Documentos internos de Meta sobre estrategia con menores

3. RAPPLER — Análisis del quiebre de la Sección 230 por enfoque en diseño del producto

4. Scimex — Costos sociales de enfermedad mental en el Reino Unido y jurisprudencia australiana

5. FinancialContent — Validación judicial de la teoría "addictive-by-design" y arquitectura de apps